2026年5月7日,ICASSP 2026 进入主会议第三天。

IVMSP 分会场围绕图像、视频与多维信号处理方向展开论文讲座。该分会场涵盖机器视觉特征编码、视觉语言模型、开放世界人机交互理解以及多智能体自动驾驶等主题,体现出图像视频处理与多模态智能模型之间日益紧密的联系。

在图像和视频编码方向中,FC-Former 相关工作(论文标题:“FC-FORMER: EFFICIENT FEATURE CODING FOR MACHINES VIA A HYBRID CNN-TRANSFORMER ARCHITECTURE”)关注面向机器视觉的特征编码问题。随着智能视觉任务对大规模数据传输和存储的需求不断增加,如何在降低冗余的同时保留对下游任务有用的语义信息,成为特征压缩中的重要问题。该工作提出一种结合 CNN 与 Transformer 的特征压缩架构,一方面利用 Transformer 捕捉全局语义信息,另一方面保留 CNN 对局部细节的建模能力,从而提升面向机器视觉任务的特征编码效果。

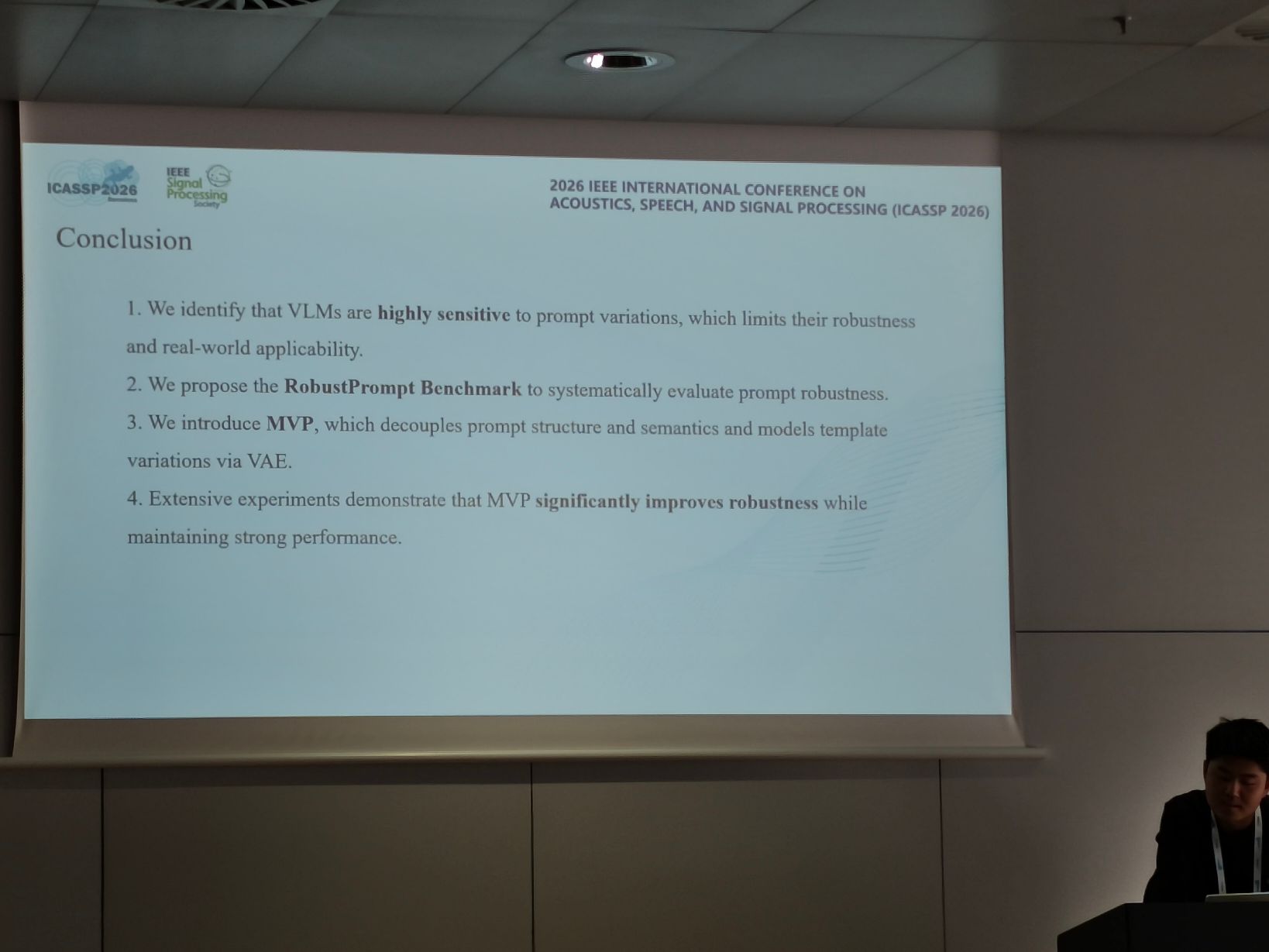

在视觉语言模型方向,MVP 相关工作(MVP: MODELING VARIANTS OF PROMPTS FOR VISION-LANGUAGE MODELS)围绕 prompt 变化对视觉语言模型鲁棒性的影响展开。以 CLIP 为代表的视觉语言模型在多种下游任务中表现出较强潜力,但其性能往往对 prompt 模板较为敏感。该工作构建 RobustPrompt Benchmark,用于系统评估视觉语言模型面对不同 prompt 变化时的稳定性,并提出 Modeling Variants of Prompts 方法,将 prompt 解耦为模板与类别名称,通过建模 prompt 结构分布来提升模型对提示变化的鲁棒性。

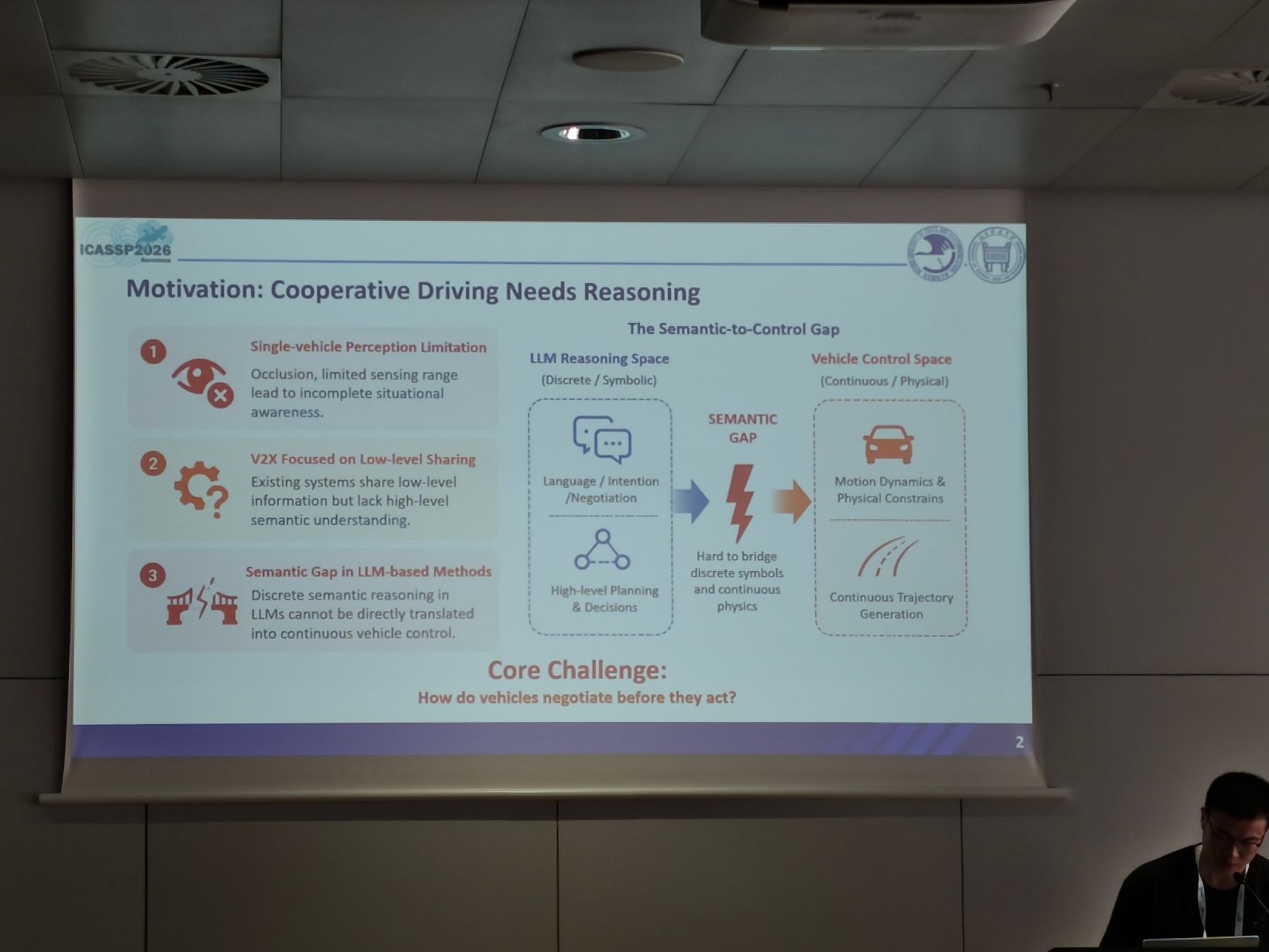

N2CDrive 相关工作(N2CDrive: Negotiate to Cooperate for Multi-Agent Autonomous Driving via Large Vision-Language Model)将视觉语言模型引入多智能体协同自动驾驶场景。多车协同驾驶不仅需要准确感知环境,还需要在多个智能体之间完成高层语义协商,并将协商结果转化为安全可行的车辆运动轨迹。该工作提出层次化框架,将语义协商与运动生成过程解耦:首先利用蒸馏后的视觉语言模型进行场景感知,随后通过大语言模型协商器生成协同决策,最后由动作序列模块将决策转化为可执行轨迹。该报告展示了视觉语言模型在复杂动态交通场景中的应用潜力。

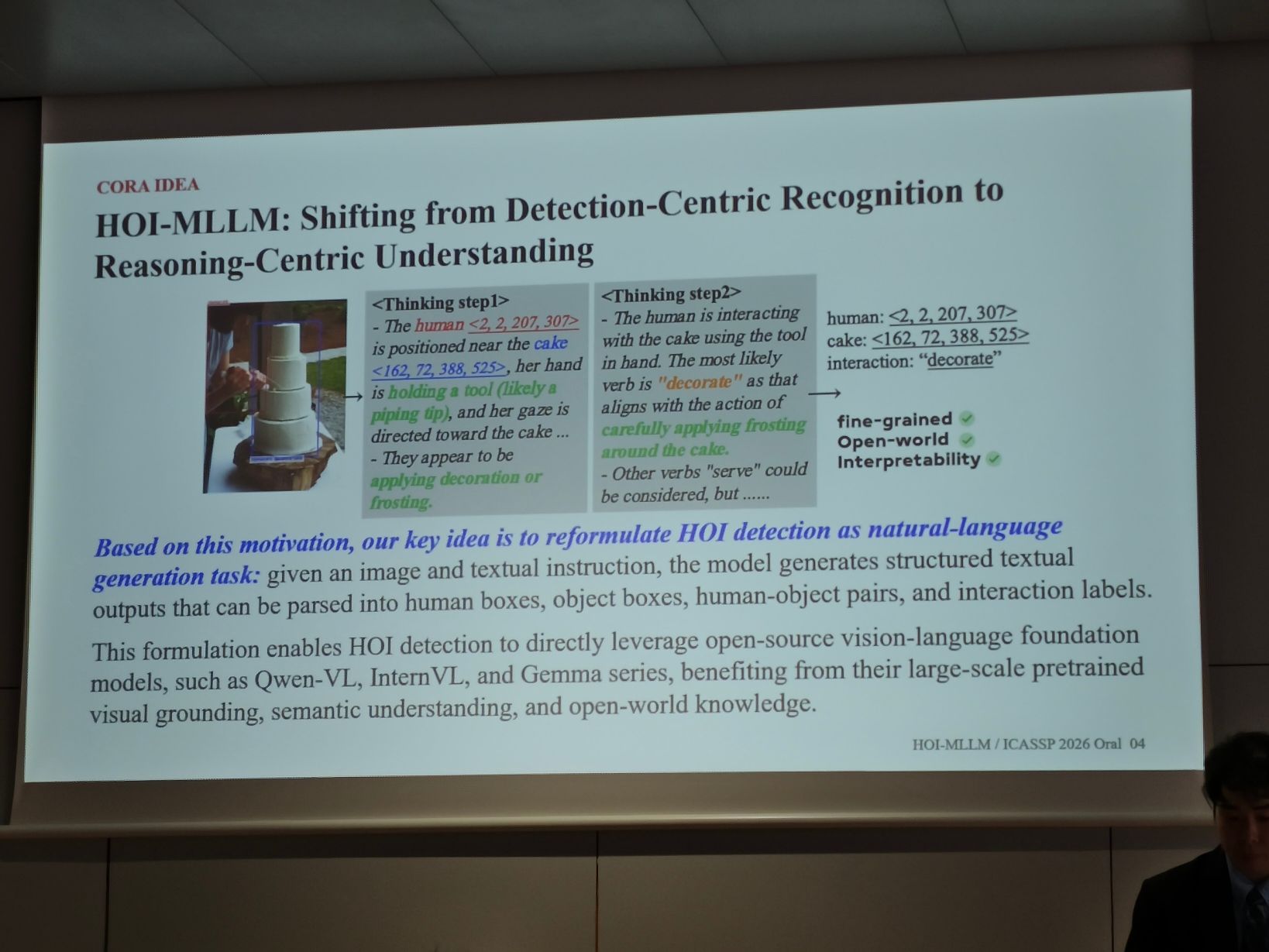

此外,HOI-MLLM 相关工作(TOWARDS OPEN-WORLD HUMAN-OBJECT INTERACTION REASONING WITH MULTIMODAL LARGE LANGUAGE MODEL)关注开放世界人机交互推理问题。传统 Human-Object Interaction(HOI)检测方法通常依赖预定义类别和固定知识,在开放世界场景中容易受到语义理解不足和解释性较弱等问题限制。该工作利用多模态大语言模型的推理能力,构建面向 HOI 检测的开放世界框架,并通过监督微调与后训练方式增强模型的交互理解能力。该研究不仅关注检测性能,也强调推理过程对结果可解释性的帮助。

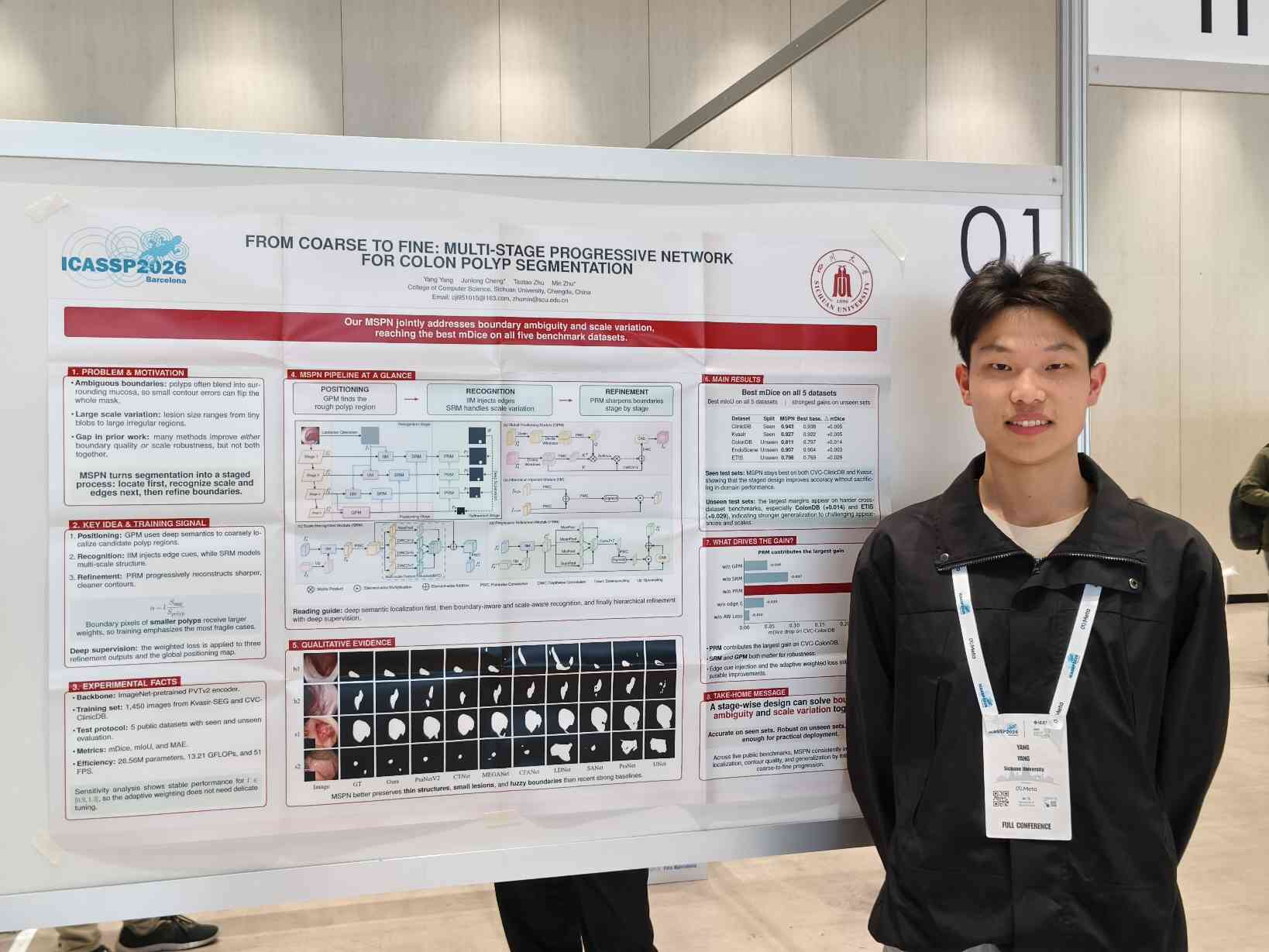

今日的海报区依然保持了较高的人流密度。来自不同方向的研究者围绕海报内容展开交流,现场讨论集中在研究动机、方法设计和实际应用等方面。相比论文讲座,海报展示提供了更加直接的交流机会,参会者可以围绕具体问题与作者进行深入讨论。

实验室25级硕士研究生杨阳展示论文《FROM COARSE TO FINE: MULTI-STAGE PROGRESSIVE NETWORK FOR COLON POLYP SEGMENTATION》,并与现场参会者进行交流。实验室工作聚焦于结肠息肉分割任务,该任务对结直肠癌早期筛查具有重要意义,但仍面临息肉边界模糊、尺度变化大以及小息肉难以精确分割等问题。针对这些挑战,论文提出 Multi-Stage Progressive Network(MSPN),采用由粗到细的多阶段框架,将分割过程划分为定位、识别和细化三个阶段,逐步提升息肉区域定位、尺度感知和边界重建能力。展示过程中,现场参会者围绕方法设计、分割效果以及泛化问题进行了交流。

ICASSP 2026 第三天的内容从分会场论文讲座延伸到海报展示,既呈现了 IVMSP 方向在多模态智能与视觉信号处理中的研究进展,也为实验室工作提供了与国际同行交流的机会。随着会议议程推进,本次参会进一步拓展了对医学图像分析和多模态学习等方向的理解。