时间:2026年5月9日(周六) 09: 00

地点:望江校区基础教学楼B座318实验室

分享者:樊禧、王艺蒙、杨鑫月

Part1

分享者:樊禧

分享内容:

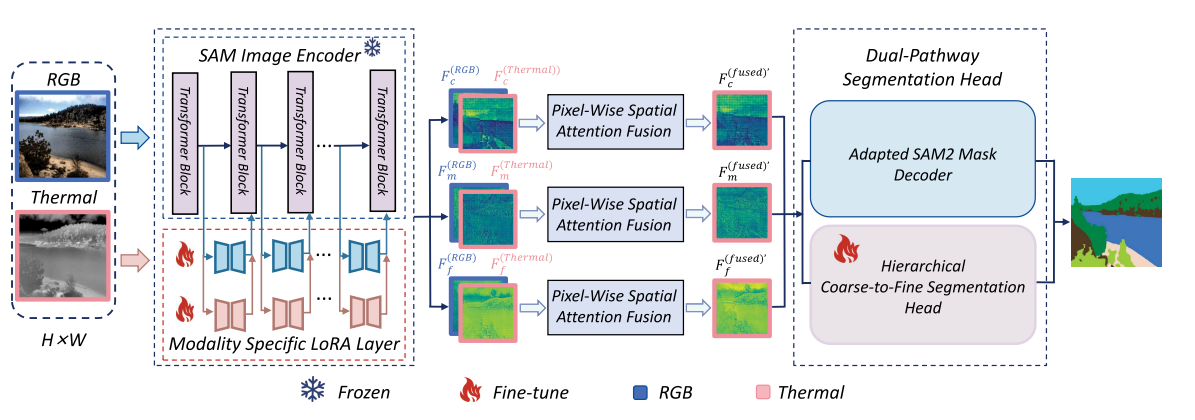

[1] C. Zhu, J. Wang, L. Zhang, J. Liang, Q. Su and B. Li, "SAM-FuseNet: Segment Anything Guided Multimodal Fusion for RGB–Thermal Aerial Robotic Perception," in IEEE Transactions on Geoscience and Remote Sensing, vol. 64, pp. 1-12, 2026, Art no. 5000212, doi: 10.1109/TGRS.2025.3648127.

基于 RGB 和热成像(RGB-T)输入的多模态语义分割对于空中机器人的稳定感知至关重要,但现有方法在有效适应预训练表示和不同光照条件下平衡互补线索方面面临挑战。为克服这些难题,本文引入了SAM-FuseNet,这是一种新颖的 RGB-T 框架,它利用基于SAM2视觉变换器骨干网的模态特定编码器,并通过低秩适应(LoRA)模块增强,从而无需对整个模型进行重新训练即可实现高效的模态特定微调。通过像素级空间注意力机制结合通道校准实现跨模态融合,允许自适应地调整每个模态的贡献权重。双路径分割头进一步提升了预测质量:第一条路径在 SAM2 的引导下逐步细化从粗到细的掩码,而第二条路径执行分层特征融合以捕获长程上下文信息。在 Caltech RGB–T 和 PST900 基准上进行的大量实验表明,SAM-FuseNet 具有显著效果,在平均交并比(mIoU)方面提高了多达 3.93%,同时训练模型的参数减少了 50% 以上。定性结果进一步表明,其边界更清晰,在曝光不足的情况下具有更强的鲁棒性,并且对模态退化具有更强的抗性。

Part2

分享者:王艺蒙

分享内容:

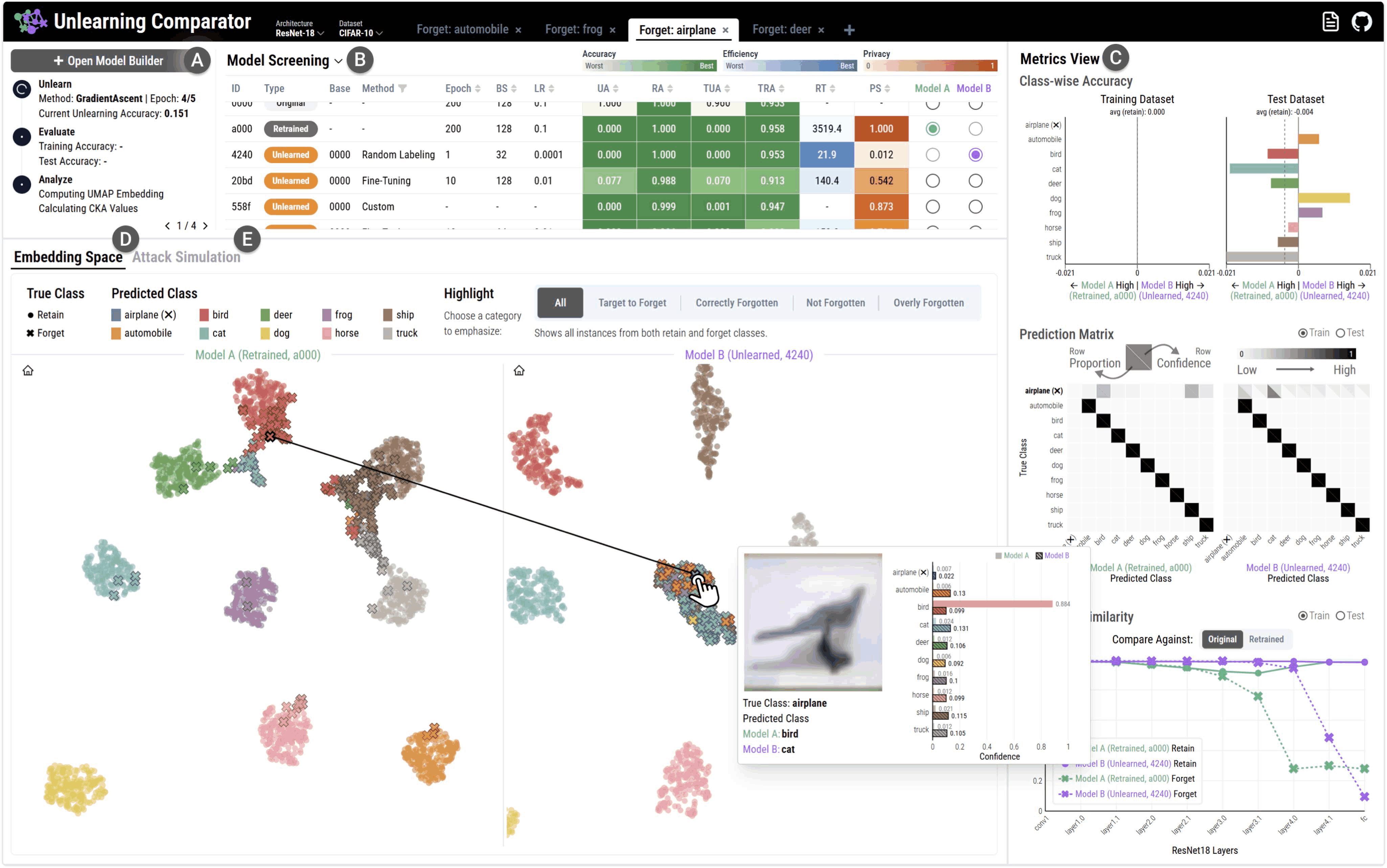

[2] J. Lee, S. Yu, Y. Jang, S. S. Woo and J. Jo, "Unlearning Comparator: A Visual Analytics System for Comparative Evaluation of Machine Unlearning Methods," in IEEE Transactions on Visualization and Computer Graphics, vol. 32, no. 3, pp. 2852-2867, March 2026, doi: 10.1109/TVCG.2026.3658325.

机器遗忘目的是从已训练的模型中移除特定训练数据,使得被移除的数据不再影响模型的行为,从而满足数据隐私法中“被遗忘权”的要求。然而,本文观察到,这一快速发展的领域中的研究者在分析和理解不同机器遗忘方法的行为时面临挑战,尤其是在准确性、效率和隐私这三个基本原则方面。因此,他们往往依赖于聚合指标和临时性评估,难以准确衡量不同方法之间的权衡关系。为了填补这一空白,本文引入了一个可视分析系统Unlearning Comparator,以促进对机器遗忘方法的系统化评估。本文的系统支持评估过程中的两项重要任务:模型比较和攻击模拟。首先,它允许用户比较两个模型(例如某种方法生成的模型与重新训练的基准模型)在类别、实例和层级上的行为,从而更好地理解遗忘后产生的变化。其次,本文系统模拟成员推断攻击,以评估方法的隐私保护能力,即攻击者试图判断特定数据样本是否属于原始训练集。本文通过案例研究对主流机器遗忘方法进行可视化分析,验证了该系统的有效性。结果表明,该系统不仅能帮助用户理解模型行为,还能为其提供改进机器遗忘方法的见解。

Part3

分享者:杨鑫月

分享内容:

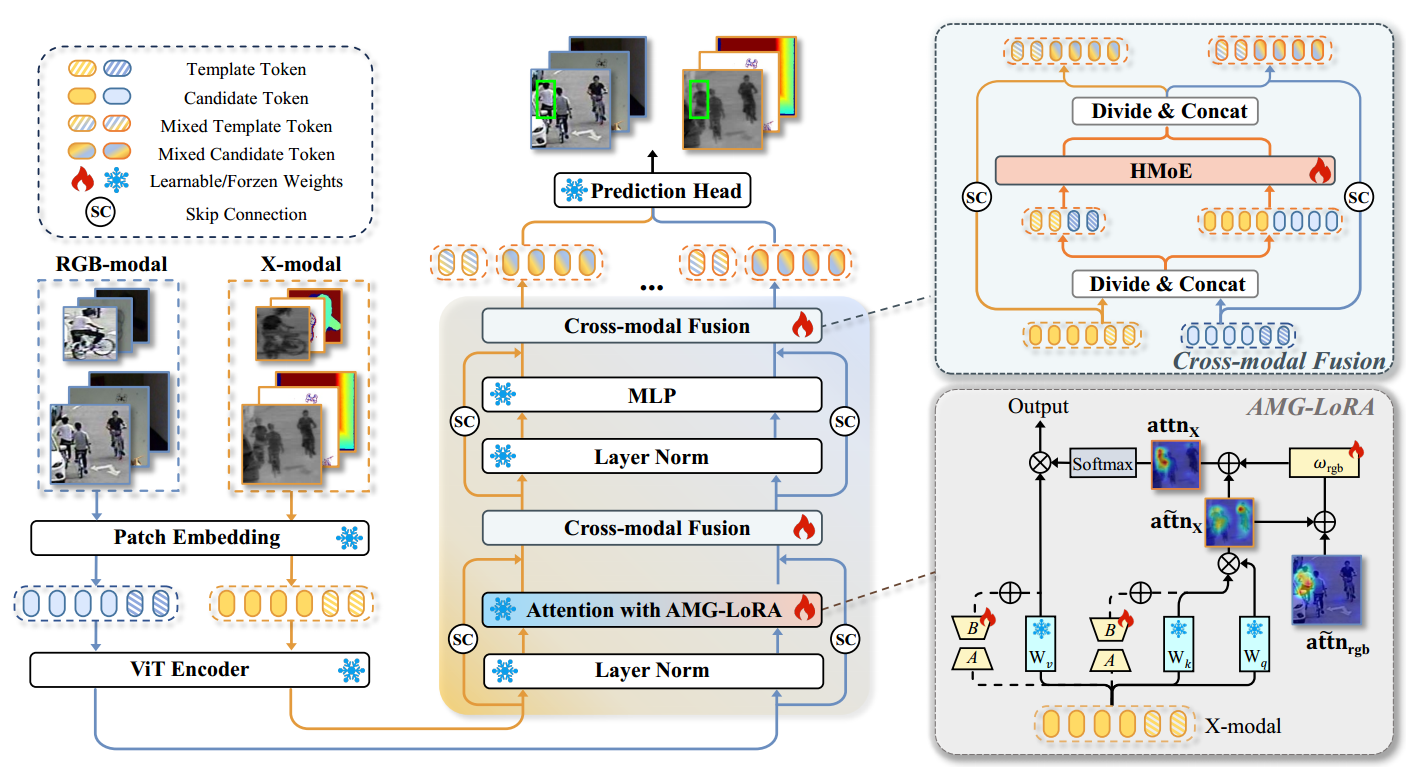

[3] Su J, Xue Z, Zhang S, et al. SEATrack: Simple, Efficient, and Adaptive Multimodal Tracker[J]. arXiv preprint arXiv:2604.12502, 2026.

多模态跟踪中的参数高效微调(PEFT)呈现出一个令人担忧的趋势:近期的性能提升往往以参数规模膨胀为代价,这从根本上违背了PEFT的高效性初衷。在本文中,我们提出SEATrack,一种简单、高效且自适应的双流多模态跟踪器,从两个互补角度解决性能-效率权衡难题。首先,我们优先关注匹配响应的跨模态对齐,这是一个尚未被充分探索但至关重要的因素,我们认为它是打破该权衡的关键。具体而言,我们发现现有双流方法中存在的模态特有偏差会产生冲突的匹配注意力图,进而阻碍有效的联合表征学习。为缓解该问题,我们提出AMG-LoRA,将用于域自适应的低秩自适应(LoRA)与自适应互引导(AMG)无缝融合,动态细化并对齐跨模态注意力图。其次,我们摒弃传统的局部融合方案,引入分层混合专家(HMoE),实现高效的全局关系建模,在跨模态融合中有效平衡表达能力与计算效率。